Apple ha mostrato costantemente l’interesse nel creare software handsfree per i propri dispositivi mobili come ad esempio l’iPhone, ed i nuovi brevetti depositati fino ad ora sembrano mostrare la strada che l’azienda possa intraprendere per rendere tali sistemi più responsivi ed efficienti rispetto allo stato attuale. Questi brevetti, scoperti da AppleInsider, mostrerebbero un assaggio di come il futuro Voice Control porebbe funzionare.

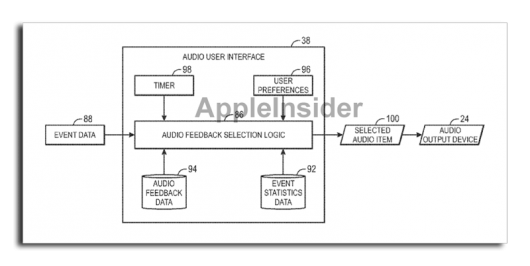

La prima applicazione, nominata Adaptive Audio Feedback System and Method, sembrerebbe sottolineare come l’attuale sistema di audio feedback sia inefficiente, in modo particolare quando si tratta di item contenenti grandi quantità di dati. Presentando tante informazioni potrebbe risultare eccessivo e rendere negativa l’esperienza dell’utente.

La soluzione di Apple prevede un taglio sulla verbosità del sistema dell’audio feedback, rendendolo più efficiente e meno frustrante per l’utente. Un esempio potrebbe essere il riconoscimento da parte del sistema di ripetizioni presenti in una lista di dati – quale una selezione di canzoni sottoposte all’udito dell’utente – come ad esempio l’artista o il nome dell’album musicale.

Un tale sistema riconoscerebbe in modo intelligente se all’utente è già stato presentata una certa informazione in qualsiasi contesto, e risparmierebbe a quest’ultimo il bisogno di subire una ripetizione. Questo potrebbe essere applicato alla navigazione di menu, notifiche e prompt.

In uno specifico esempio pervenuto, il prompt audio “Genius is not available” è sostituito da un più corto e più efficiente “No Genius.” Il tutto potrebbe essere reso ancora più efficiente sotto forma di un input audio, quale un tono negativo o beep. Tuttavia il sistema potrebbe funzionare anche al contrario ed aumentare la verbosità in base alle preferenze dell’utente così da presentare informazioni più importanti.

Questo sistema dinamico risparmierebbe all’utente il bisogno di ascoltare ripetutamente lo stesso prompt, in particolare se quest’ultimo sta svolgendo un compito con il proprio iPhone con cui è già familiare. Prompt più corti non solo sono meno fastidiosi, ma potrebbero la navigazione handsfree ancor più veloce.

Apple avrebbe inoltre trattato il lato del Voice Control in un’altro brevetto questa settimana, intitolato Processing of Voice Inputs, con riferimento alla frustrazione che spesso emerge nell’utente durante l’utilizzo del sistema Voice Control.

La descrizione nota che, spesso al sistema serve troppo tempo per processare e interpretare il comando vocale dell’utente, con il risultato di portare ad un sistema meno efficiente e alla frustrazione per l’utente. Ad esempio quest’ultimo e il sistema potrebbero trovarsi a parlare uno sopra l’altro a causa di problemi legati al tempismo.

A causa del tempo richiesto per ricevere un intero input vocale, processare l’input vocale e determinare il contenuto dell’input vocale, un particolare input vocale che l’utente ha comunicato in risposta ad un primo prompt potrebbe essere processato e compreso dopo che il primo prompt è terminato e mentre il secondo è comunicato” si legge sull’applicazione. “Il dispositivo può successivamente avere difficoltà a determinare quale prompt associare con l’input vocale ricevuto”.

La soluzione di Apple prevede spazi di tempo dinamici associati a prompt di sistema, offrendo un appropriata finestra in cui la voce dell’utente può essere data. I prompt presentati dal sistema potrebbero avere qualsiasi combinazione in termini di spazi di tempo o range.

Queste finestre per l’input potrebbero essere aumentate o diminuite in modo dinamico in base ad un numero di fattori. Ad esempio, il sistema potrebbe concedere all’utente più o meno tempo per rispondere ad un prompt, in base alla sua storia d’utilizzo del sistema, o anche alle sue caratteristiche vocali individuali.

Sia il Wall Street Journal che il New York Times hanno riportato ad inizio di quest’anno l’impegno di Apple nel migliorare la navigazione vocale nel prossimo grande update di iOS, il sistema operativo mobile su cui sono basati l’iPhone e l’iPad. Un report successivo affermava che i comandi vocali sarebbero stati profondamente integrati in iOS 5.

Le fondamenta per l’anticipato lavoro di Apple sul Voic Control sono iniziate dall’acquisto di Siri da parte dell’azienda di Cupertino, un’applicazione personal assistant pesantemente dipendente dai comandi vocali. Attraverso Siri, gli utenti possono immettere comandi al proprio iPhone utilizzando frasi complete, quali ad esempio “Cosa succede questo fine settimana qui vicino?”.

Il mese scorso fu dichiarato che queste nuove feature non erano pronte per essere mostrate al WWDC. Tuttavia, fu suggerito che le suddette feature potrebbero essere mostrate questo autunno e saranno parte del tanto anticipato iPhone di quinta generazione.

Via | AppleInsider

Leggi o Aggiungi Commenti