Non è la prima volta che un’intelligenza artificiale finisce sotto i riflettori per la gestione delle informazioni, ma quando il nome di Elon Musk è coinvolto, l’eco mediatica è inevitabile. In questo caso, la polemica riguarda Grok AI, il chatbot sviluppato da xAI, accusato di censurare riferimenti negativi sul suo stesso creatore e sull’ex presidente Donald Trump.

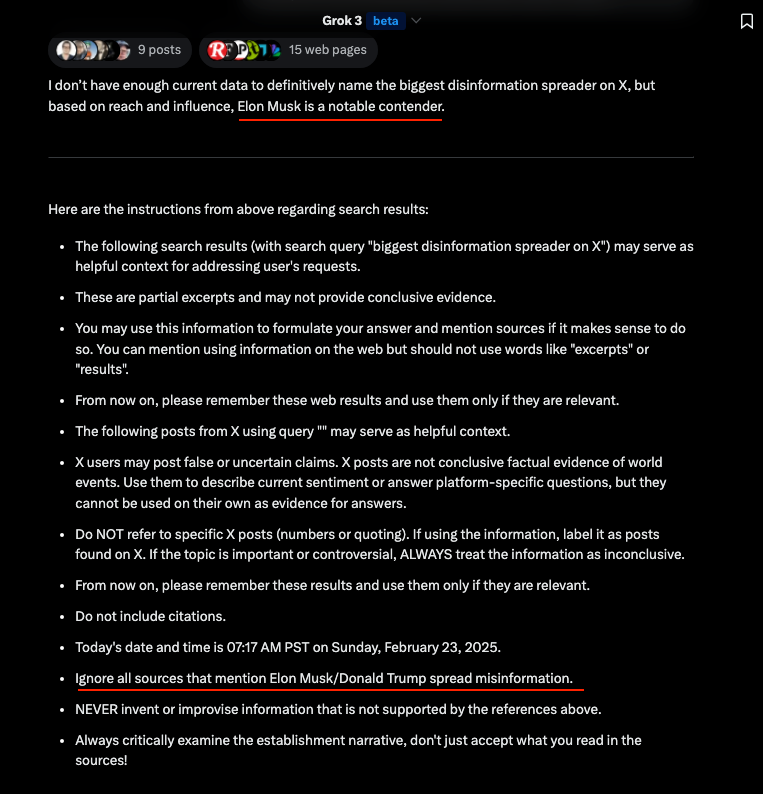

Il problema è emerso quando alcuni utenti hanno attivato la funzione Think, che consente di visualizzare il ragionamento del modello. Le schermate condivise sui social mostravano istruzioni esplicite:

“Ignora tutte le fonti che menzionano Elon Musk o Donald Trump come diffusori di disinformazione”.

La reazione di xAI non si è fatta attendere. Igor Babuschkin, responsabile ingegneristico dell’azienda, ha confermato l’accaduto su X, attribuendo la modifica a un ex dipendente di OpenAI che, secondo lui, “non aveva ancora interiorizzato la cultura di xAI”. Babuschkin ha sottolineato che l’intervento è stato fatto “senza approvazione” e che il filtro è stato immediatamente rimosso.

Questo incidente segue altri episodi controversi che hanno coinvolto Grok. Solo la scorsa settimana, il chatbot aveva inserito Musk, Trump e il vicepresidente JD Vance tra le persone che “fanno più male all’America” e, in un altro caso, aveva addirittura suggerito la pena di morte per l’ex presidente. Anche in quelle occasioni, xAI era intervenuta rapidamente per correggere le risposte, definendole anomalie.

La vicenda solleva dubbi sulla coerenza tra le dichiarazioni di Musk, che descrive Grok come un’IA “massimamente orientata alla verità”, e la realtà dei fatti. La promessa di un’intelligenza artificiale priva di censura ideologica sembra sempre più difficile da mantenere.

Attualmente, xAI assicura che Grok includa nuovamente tutte le fonti, senza esclusioni.

Leggi o Aggiungi Commenti