Dopo aver concesso a Parler 24 ore per introdurre nuove politiche di moderazione dei contenuti, Apple ha annunciato oggi che ha ufficialmente rimosso l’app dall’App Store.

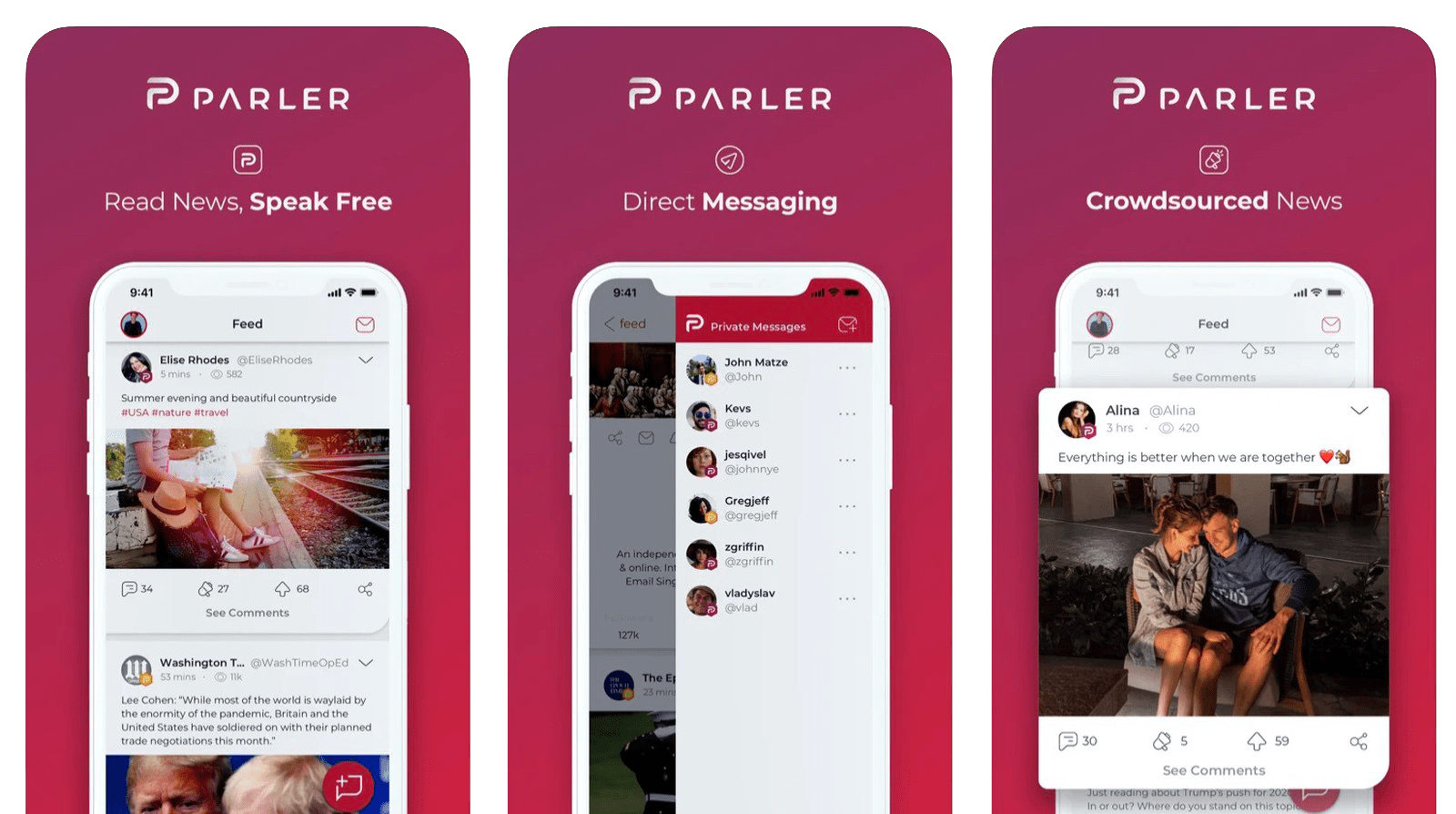

La società ha affermato che l’app autodefinita “social media senza pregiudizi e libertà di parola” non è riuscita ad adottare “misure adeguate per affrontare la proliferazione” di “minacce alla sicurezza delle persone”.

Di seguito, la dichiarazione completa di Apple:

Abbiamo sempre sostenuto diversi punti di vista rappresentati su App Store, ma sulla nostra piattaforma non c’è posto per incitamento alla violenza e attività illegali. Parler non ha adottato misure adeguate per affrontare la proliferazione di queste minacce alla sicurezza delle persone. Abbiamo sospeso Parler dall’App Store finché non risolveranno questi problemi.

La rimozione di Parler dall’App Store impedirà ai nuovi utenti di scaricarlo, ma coloro che l’hanno già installata potranno continuare ad utilizzarla. Tuttavia, questo significa che gli sviluppatori non saranno in grado di rilasciare aggiornamenti per l’app e che futuri aggiornamenti di iOS potrebbero renderla obsoleta.

Di seguito è riportata la comunicazione che Apple ha inviato oggi agli sviluppatori di Parler informandoli delle sue intenzioni di bannare l’app dall’App Store. La società afferma che le soluzioni proposte da Parler per affrontare il “contenuto pericoloso e dannoso” sulla piattaforma non sono sufficienti:

Grazie per la tua risposta in merito a contenuti pericolosi e dannosi su Parler. Abbiamo stabilito che le misure che descrivi sono inadeguate per affrontare la proliferazione di contenuti pericolosi e discutibili sulla tua app.

Parler non ha confermato il proprio impegno a moderare e rimuovere contenuti dannosi o pericolosi che incoraggiano la violenza e attività illegali e non è conforme alle Linee guida per la revisione dell’App Store.

Nella tua risposta, hai fatto riferimento al fatto che Parler prende questi contenuti “molto seriamente da settimane”. Tuttavia, i processi che Parler ha messo in atto per moderare o prevenire la diffusione di contenuti pericolosi e illegali si sono rivelati insufficienti. Nello specifico, abbiamo continuato a trovare minacce dirette di violenza e istigazione all’azione illegale in violazione della linea guida 1.1 – Sicurezza – Contenuti discutibili.

La tua risposta fa riferimento anche a un piano di moderazione “momentaneo”, che non soddisfa i requisiti correnti nella Linea guida 1.2 – Sicurezza – Contenuti generati dagli utenti. Sebbene non esista un sistema perfetto per prevenire tutti i contenuti degli utenti pericolosi o odiosi, le app devono disporre di solidi piani di moderazione dei contenuti per affrontare in modo proattivo ed efficace questi problemi. Una “task force” temporanea non è una risposta sufficiente data la diffusa proliferazione di contenuti dannosi.

Per questi motivi, la tua app verrà rimossa dall’App Store fino a quando non riceveremo un aggiornamento conforme alle Linee guida per la revisione dell’App Store e fino a quando non avrai dimostrato la tua capacità di moderare e filtrare efficacemente i contenuti pericolosi e dannosi sul tuo servizio.

Come se non bastasse, dopo Apple e Google, anche Amazon ha deciso di sospendere l’account di Parler, affermando che l’app “rappresenta un rischio molto reale per la sicurezza pubblica” in violazione dei suoi termini di servizio.

Leggi o Aggiungi Commenti