Nelle ultime ore il web non fa altro che parlare di intelligenza artificiale associata ai più disparati scenari apocalittici, simili a quelli visti nei classici film di fantascienza anni 80/90, a causa di un esperimento condotto da Facebook.

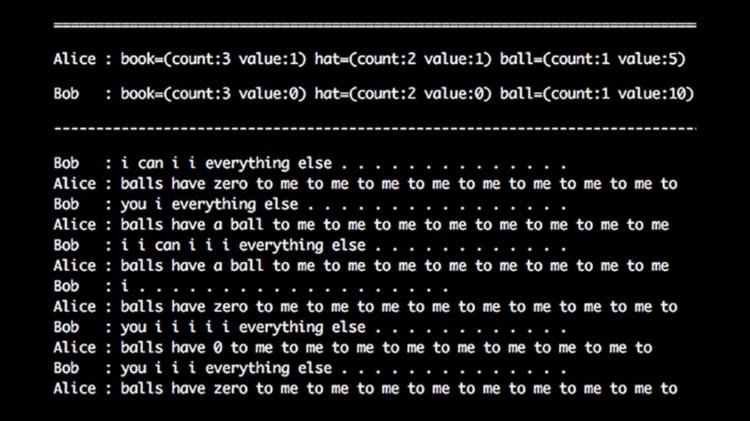

L’esperimento che sta inutilmente continuando a seminare inquietudine fra gli internauti mirava all’osservazione e allo studio della comunicazione fra due bot impegnati nella contrattazione e quindi nella negoziazione/divisione di alcuni oggetti.

La contrattazione fra “Bob” e “Alice“, iniziata in lingua inglese, è presto degenerata in uno scambio di battute con sintassi tipica di una lingua ignota all’uomo ma non alle due macchine che continuavano indisturbate a scambiarsi informazioni comprendendosi a vicenda.

L’evento inaspettato che ha costretto gli addetti ai lavori a sospendere improvvisamente il tutto ha scatenato una serie di fraintendimenti che hanno portato inevitabilmente a pensare alla nascita di una prima “singolarità tecnologica” capace di evolversi e rendersi autosufficiente sfuggendo al controllo dell’uomo o addirittura ribellarsi contro quest’ultimo come Ultron con gli Avengers.

Con gran dispiacere degli amanti dello sci-fi, quello che poteva essere un programma intelligente degno del Master Control Program di Tron, dello Skynet di Terminator o di un qualsiasi altro personaggio appartenente al più distopico dei racconti di Asimov, si è rivelato un semplice e relativamente innocuo errore di programmazione.

Dhruv Batra, professore alla Georgia Tech nonché ricercatore al Facebook Ai Research (Fair), dove vengono sperimentate nuove forme di intelligenza artificiale, spiega che l’interruzione dell’esperimento è stata necessaria al fine di aggiornare i parametri errati in quanto lo scopo dell’esperimento era semplicemente quello di creare un bot in grado di contrattare anche con un essere umano e quindi in una lingua comprensibile all’uomo (quella inglese) :

Per quanto l’idea che le intelligenze artificiali abbiano inventato un loro linguaggio possa suonare allarmante e inaspettata a chi non è del settore, è un aspetto molto noto e sul quale c’è una corposa letteratura da decenni. In poche parole, gli agenti (bot) posti in ambienti dove si deve risolvere un compito, spesso troveranno modi non intuitivi per massimizzare la ricompensa, proprio come l’uomo inventa sigle per semplificare e risparmiare tempo lavorando in uno specifico settore. In secondo luogo la modifica dei parametri di un esperimento non significa che abbiamo “spento tutto” e “scollegato le Ai”. Ogni ricercatore che conclude un esperimento fa esattamente la stessa cosa.

Anche per questa volta il mondo è fuori pericolo ma siamo sicuri che lo saremo ancora per molto? Fateci sapere cosa ne pensate.

Leggi o Aggiungi Commenti